こんにちは!AI-Bridge Labのせいやです😊

Google DeepMindは2025年3月12日、最新のオープンソース大規模言語モデル(LLM)「Gemma 3」を発表しました。

このGemma 3は誰でも自由に活用できるオープンソースモデルで、ローカル環境(オフライン)での利用が可能です。

手持ちのパソコンやスマホなど、自分のデバイス上で動かせるため、セキュリティ面でも安心して使うことができます。

今回は、「Gemma 3」の特徴や仕様、試験データ、使用方法、他のモデルとの比較など、現在分かっている情報を詳しくご紹介します。

Gemma3とは

Gemma 3は、Google DeepMindが開発した最新世代のオープンソース大規模言語モデル(LLM)です。単一のGPUやTPU上で高速に動作するよう設計された「軽量モデル」で最先端の技術として公開されました。

Gemma 3は前身のGemmaシリーズの技術を基に、Googleの先端モデルであるGemini 2.0の研究成果も取り入れて構築されています。

Gemma 3の主な特徴 5つ

①軽量でデバイス上でも動作可能

Gemma 3はモデルサイズごとに最適化された軽量なLLMで、小型モデルはスマホやラップトップでも動作して、大型モデルは単一GPUでの推論が可能です。オフライン音声アシスタントやプライバシー重視のチャットボットなどにも活用できます。

②マルチモーダル

テキストだけでなく画像や短い動画を入力して解析できるマルチモーダルな能力を備えています。

4B以上のモデルには、Google独自の視覚エンコーダ(SigLIPベース)が搭載され、画像入力に対応し、画像キャプション生成やビジュアルQA(画像の内容に基づく質問応答)が可能です。

③超長文コンテキスト

最大128,000トークンという非常に長いコンテキストウィンドウを持ち、膨大な文書や複数の文書の情報を一度に取り込んで処理することができます。

④関数呼び出しと構造化出力

ChatGPTなどと同様に関数呼び出し(function calling)インタフェースをサポートし、モデルからプログラム的な関数実行やツール使用を行えるようになっています

⑤公式量子化モデルの提供

Gemma 3では公式に量子化済みモデル(INT4やスイッチドFP8形式など)が提供されていて、モデルサイズと計算負荷を大幅に削減して高速化することができます。

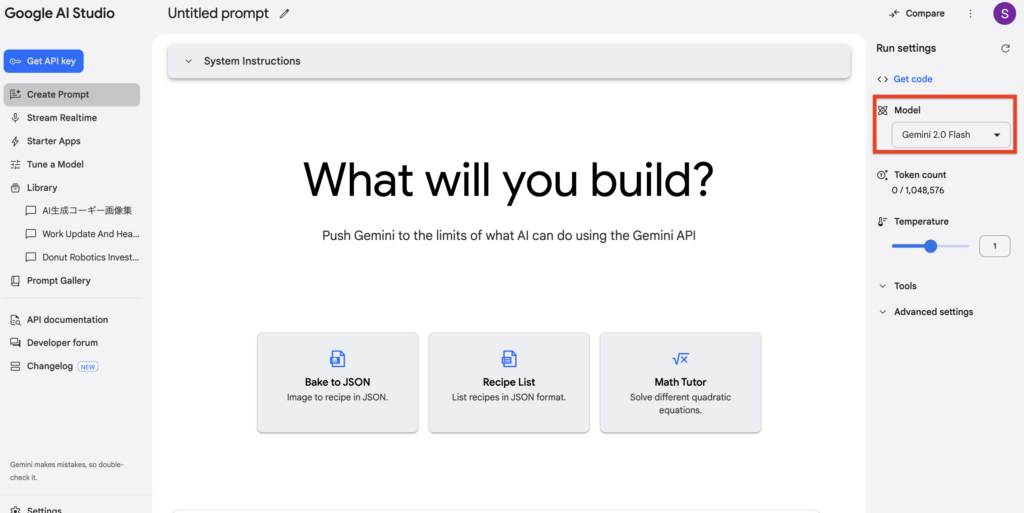

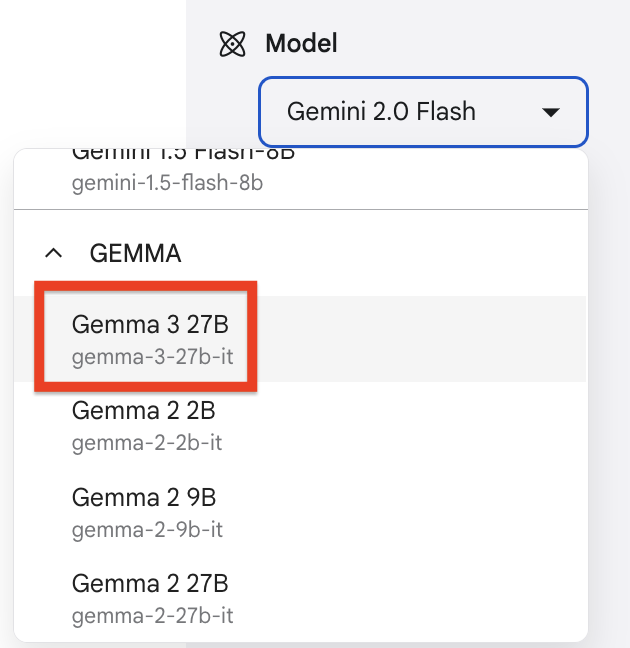

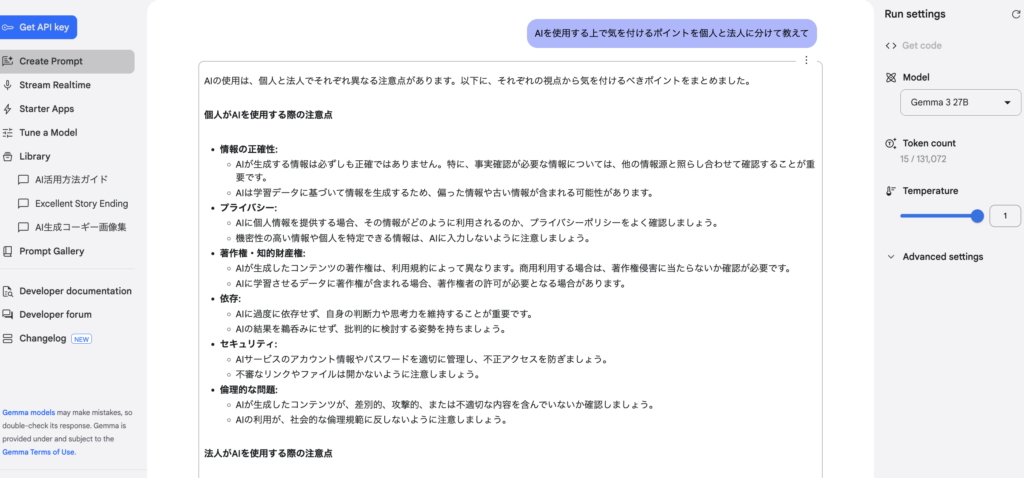

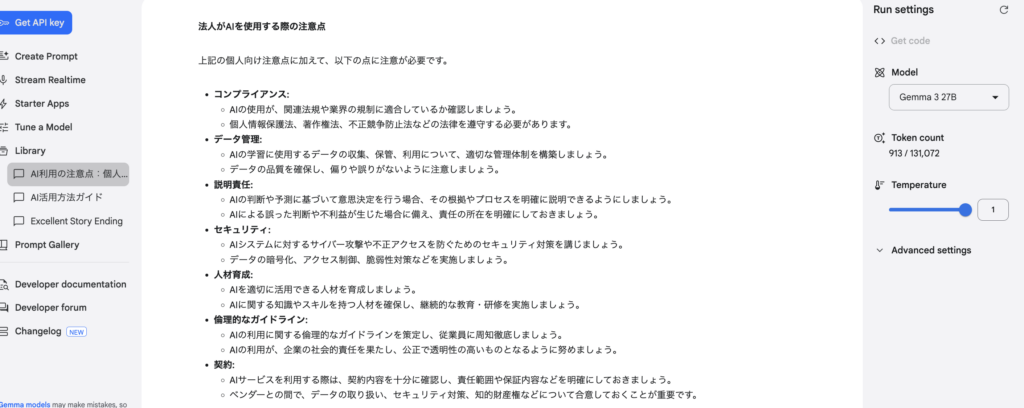

使い方

今回はGoogle AI studioで使用する方法をお伝えします。

試験データ

Gemma 3の性能は各種ベンチマークで非常に高く評価されています。

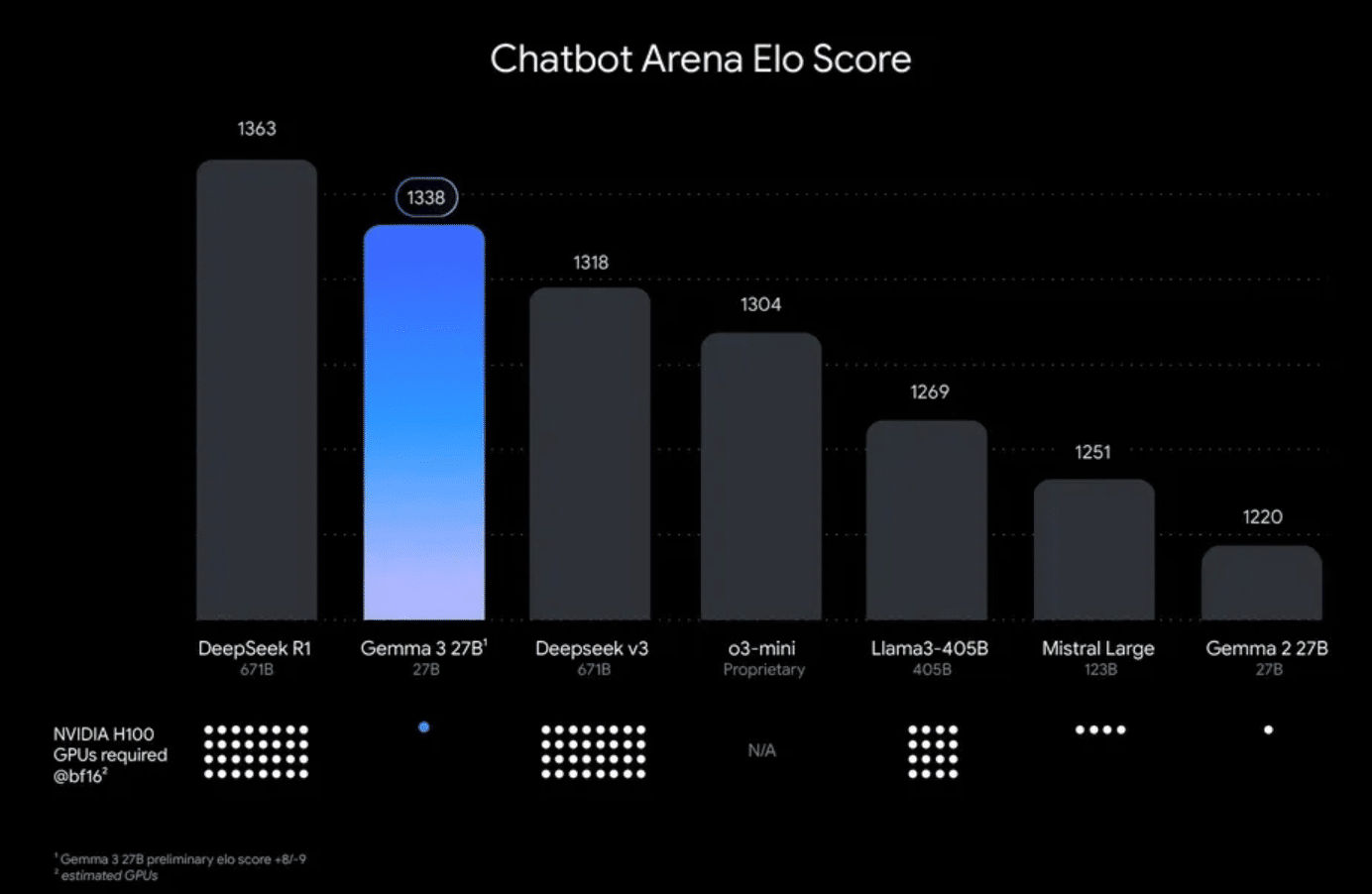

下のグラフはLMSYS Chatbot Arenaにおけるモデル別のEloスコア比較で、Gemma 3 (27B) が1338という高いスコアを記録し、これは大規模モデルのDeepSeek R1 (67B) の1363に迫る値です。

しかも、Gemma 3 27Bはこれらの大規模モデルと異なり推論に必要なGPUが一台で済むため、計算資源あたりの効率で見るとかなり優秀です。

LMSys Elo スコア

LMSys Elo スコアは、人間の好みに基づいて直接対決でどれだけ優れたパフォーマンスを発揮するかに基づいて言語モデルをランク付けする数値です。

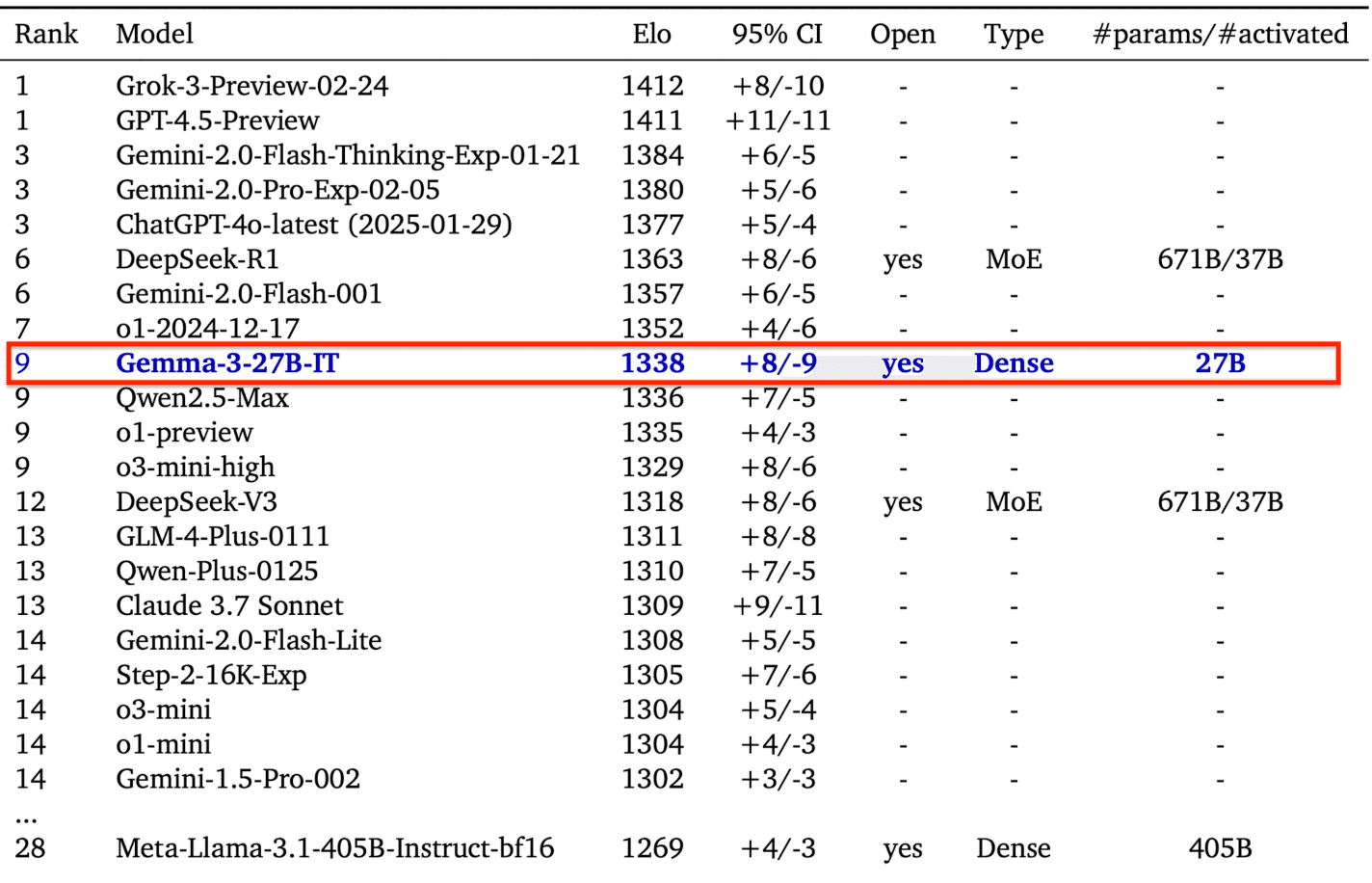

LMSys Chatbot Arena(下の表)では、Gemma 3 27B IT は Elo スコア1339を報告しており、トップのクローズド モデルを含む上位 10 位のモデルにランクされています。

これは表内の他の LLM と同様に、テキストのみの入力で動作する Gemma 3 ののスコアです。

上記の表をまとめると

・LMSYS Chatbot Arena において Gemma 3 27B は1338 Elo という高スコアを記録。

・MMLU(知識問題)、GSM8K(数学)、HumanEval(コード生成)などでLLaMA 3 (推定405B)を上回る成績。

・Gemma 3-4B-IT は Gemma 2-27B-IT に匹敵する性能。

他のAIモデルとの比較

Gemma 3はオープンソースかつ軽量な点で、OpenAIのGPT-4やAnthropicのClaude 2といったクローズドソースのモデルと一線を画しています。

GPT-4やGoogleのGeminiは内部構造が非公開で、利用するにはAPI経由の課金が必要ですが、Gemma 3はモデル自体が一般公開され自由にダウンロードして無料で使用することができます。

また、MetaのLLaMA 2はオープンモデルですが競合企業の利用を制限するライセンスが付与されていたのに対して、Gemma 3にはそういった商用利用の制限がありません。

つまり、Gemma 3は企業・個人を問わず、あらゆるユーザーが自由に扱える、まさに「本当の意味でのオープンモデル」なのです。

まとめ

今回は「Gemma 3」について解説しました。

Gemma 3は、オープンソースのAIモデルとして高性能・軽量・拡張性の高さを兼ね備えたモデルであり、特にローカル実装や自分や企業用にカスタマイズしながら使いたいユーザーには非常に魅力的なツールと言えます。

また、プライバシーやセキュリティを重視する環境でも活用しやすく、商用利用をする開発者向けのドキュメントやコミュニティの支援も充実しており、幅広い用途での応用が期待されています。

Gemmaシリーズの今後のアップデート情報も引き続き追っていきます!

AI-Bridge Labについて

AI-Bridge Labでは、今後も生成AIの活用事例について、継続的に情報を発信していきます。

最新のAI技術とその活用方法について、ぜひ一緒に学んでいきましょう!

最後まで読んでいただき、ありがとうございました。 気に入って頂けましたら「スキ」や「フォロー」「コメント」をしていただけると幸いです😄

コメント