こんにちは!AI-Bridge Labのせいやです😊

Claude 3.7 SonnetやReplit Agent V2のリリースでアプリ開発が身近になり、コーディング作業に触れる機会が増えた方もいると思います。

ただ複雑なアルゴリズムを実装する際に何時間もデバッグ(修正)に費やしたり、同じようなコードを何度も書いたりして「コーディングがもっと効率的になってくれたらなぁ」と思ったことはありませんか?

実は今、そんなユーザーの悩みを解決する可能性を秘めたツールが注目を集めています。

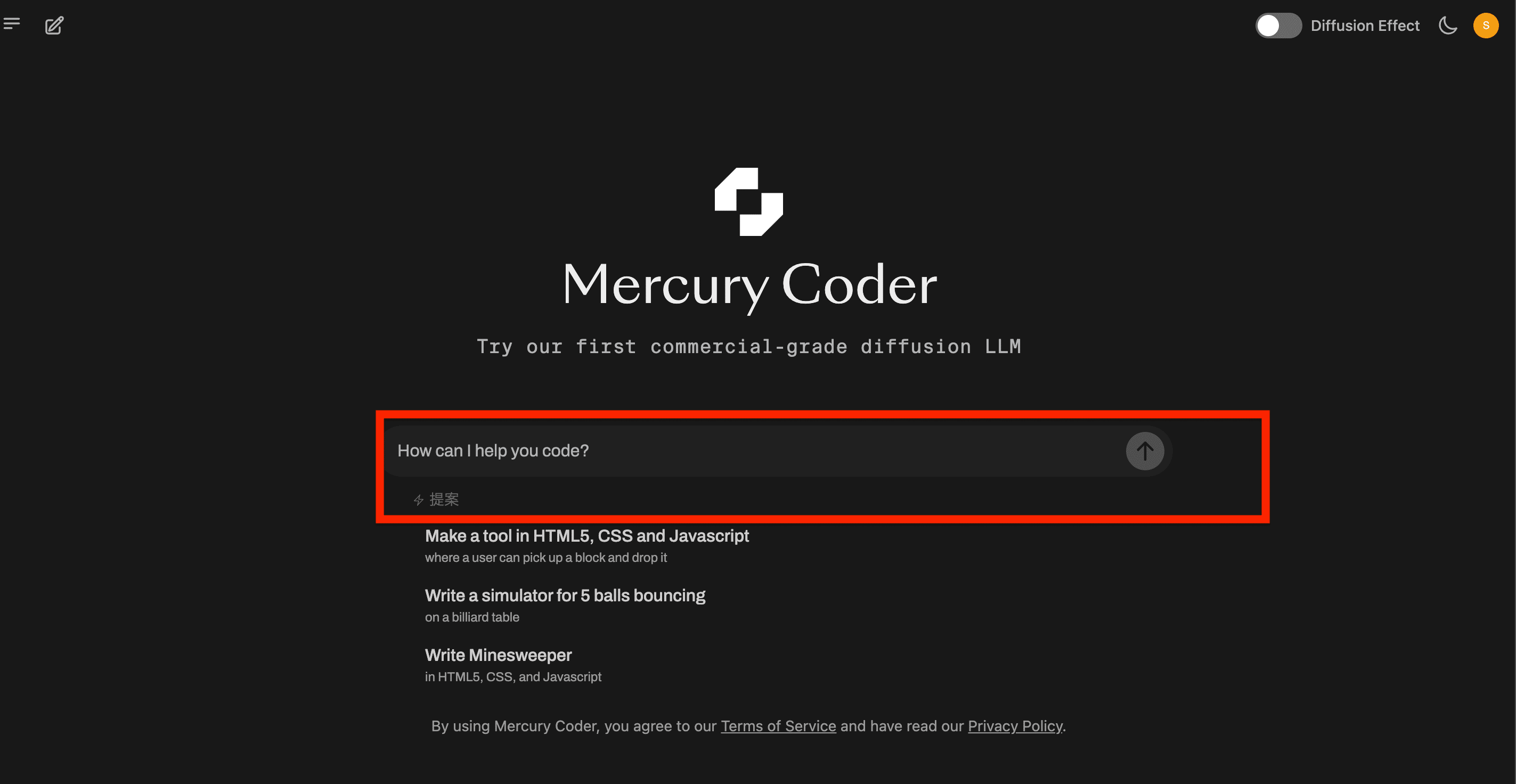

それが、AIを活用して爆速でコーディングを書いてくれる「Mercury Coder」というツールです。

この記事ではMercury Coderの特徴や機能、公式が発表しているデータや実際のコーディング比較などについて詳しく解説していきます。

Mercury Coderとは

Inception Labs社が開発したMercury Coderは、AIを活用したコーディングに特化したLLMモデルで、コード生成、補完、デバッグの自動化を通じて生産性を上げるサポートをしてくれます。

一般的なLLMモデルと比べても爆速でコードを生成してくれるためユーザーがコードを書く時間を大幅に短縮して、より創造的なタスクに集中できる時間を作ってくれます。

なぜそんなに早く出力できるのか

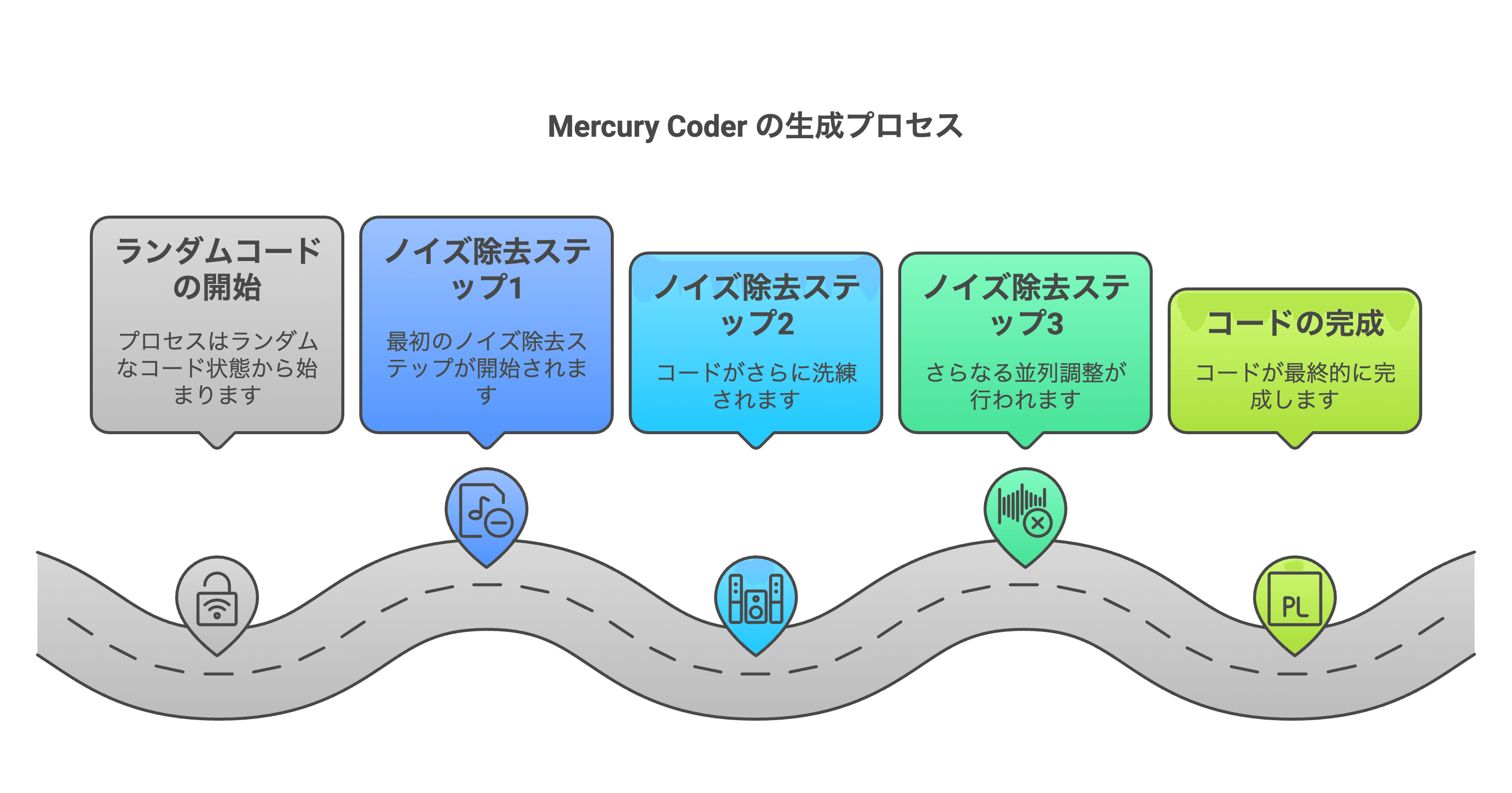

一般的な言語モデルは、左から右へ1トークンずつ順番に生成する「自己回帰型」という方式ですが、Mercury Coderはまずランダムな(または「ノイズ状態」の)コードからスタートします。そして、複数のステップを通じてその「ノイズ」を徐々に取り除きながら、コード全体を一度に並列で整えていく「粗から細へ」アプローチ(Diffusion型)を採用しています。

文章作成に例えると、

普通の言語モデル(自己回帰型)は、一文字ずつ順番に書く方法です。

小説を書くときに最初の一文から順番に書いていくようなイメージですね。

一方で、Mercury Coder(Diffusion型)は、まず全体の下書きをザックリ作り、そこから徐々に完成させる方法です。例えるなら、小説を書くときに最初に大まかなストーリーや構成を決めて、次に章ごとの流れを作り、最後に細かい言葉を整えて仕上げるようなイメージです。

この仕組みによって、一度に多くの部分を同時に処理できるため、従来の方式よりも高速に、コードが生成できるのです。

使い方

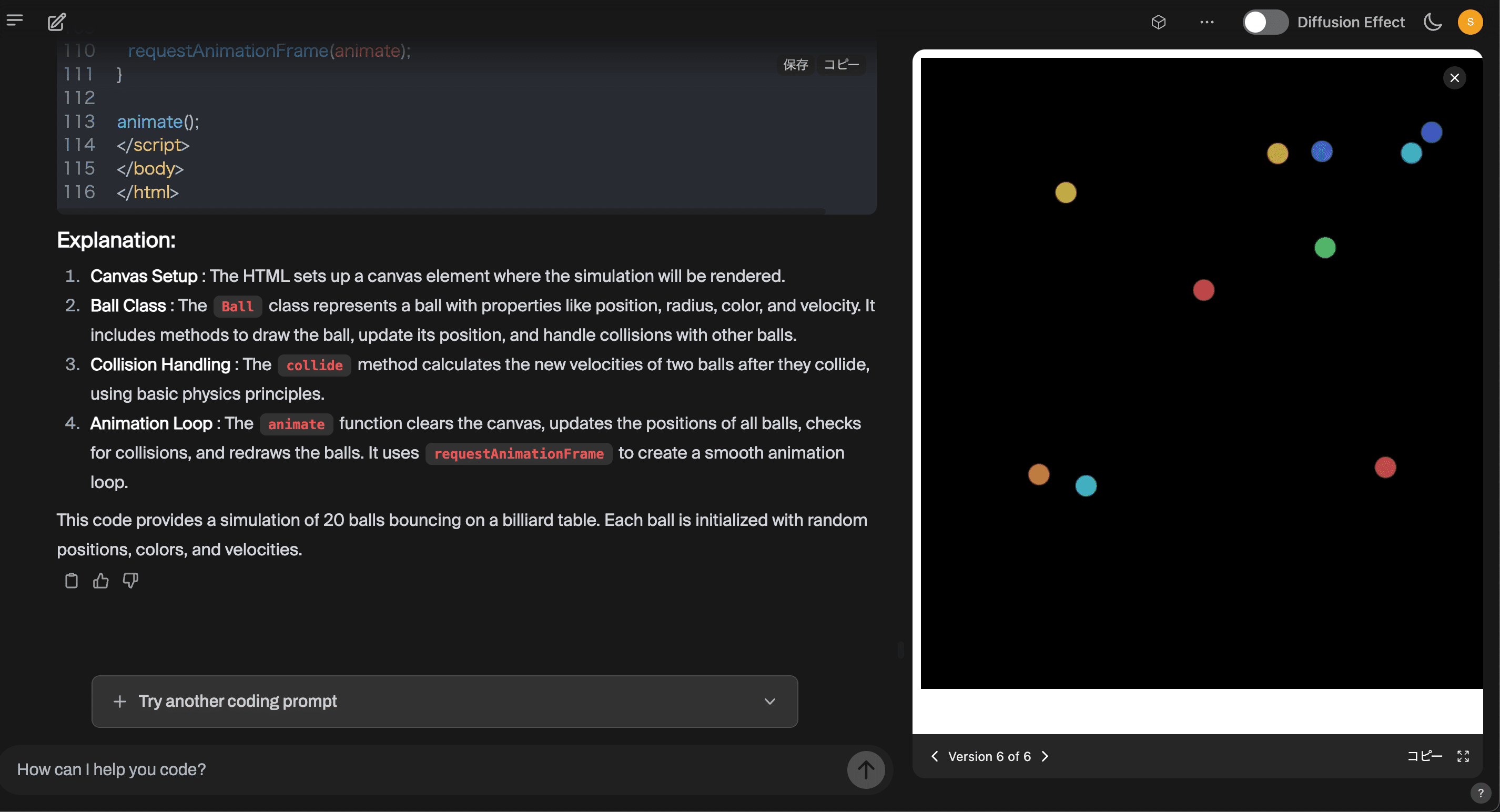

Mercury CoderとClaude 3.7 Sonnetのコーディング速度の検証

内容:マインスイーパーを作成する時間を比べる

結果:Mercury Coderが6秒、Claude 3.7 Sonnet 57秒

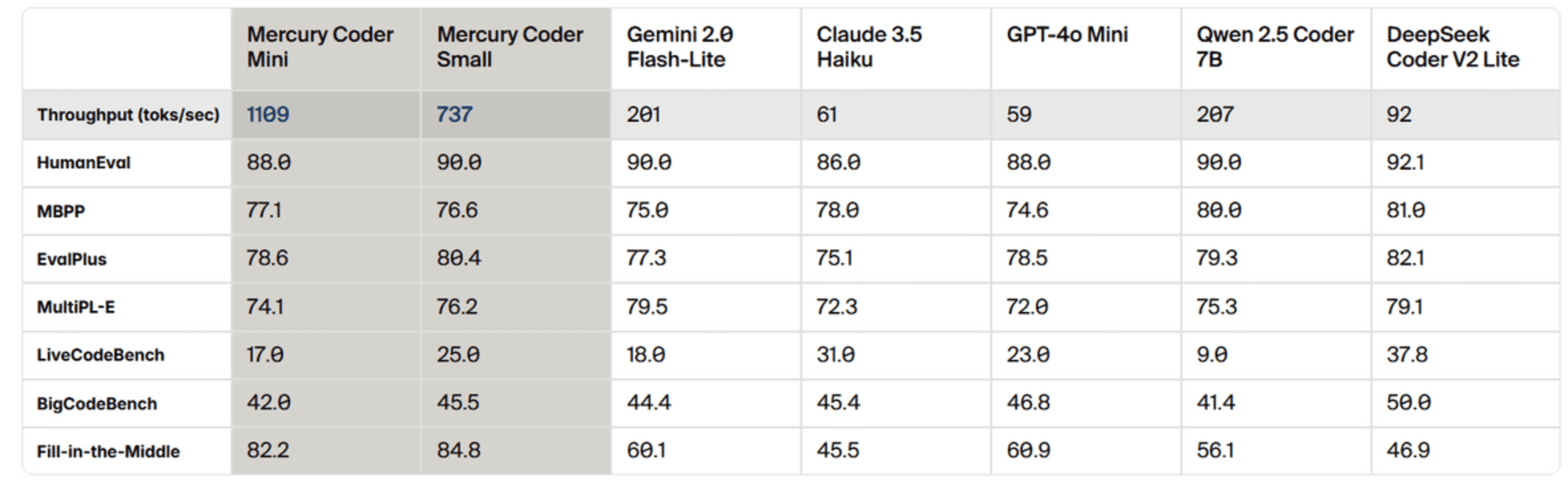

データで見るMercury Coder

大規模言語モデルの評価指標であるHumanEvalやMBPP、EvalPlusを使った検証結果を表にしたものです。

Copilot Arenaという、AIのコーディング能力を比べて人間が投票するプラットフォームでも高い評価を得ています。

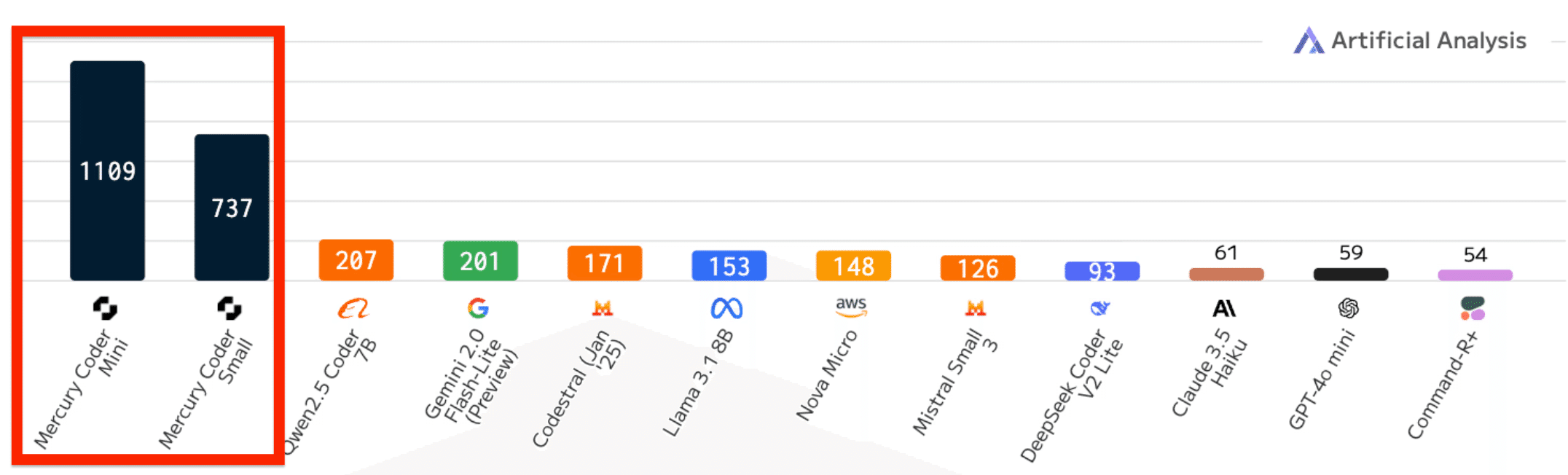

各LLMモデルの1秒あたりの出力トークン数を比べたグラフ

Diffusionモデルのコード生成における課題

1.全体を一度に作るので、細かい繋がりが難しい

コードは、単語や記号が順番に並ぶパズルのようなものです。

Diffusionモデルは最初に全体を一度に作り始め、いくつかのステップを同時に修正する方式なので、細かい繋がり(例えば、変数名や論理の流れ)がうまく維持できないことがあります。

2.直す過程で小さなミスがたまる可能性がある

Diffusionモデルは「ノイズ状態」から何度も直していく(デノイジング)ことで、最終的なコードを作ります。この「直す」作業の途中で、ちょっとした誤りが発生することがあり、その小さなミスが何回も繰り返されると、最終的なコードにエラーが残ってしまう可能性があります。

3.もともと画像用に作られた技術を使っているため、コードのような離散的なデータに合わない部分がある

Diffusionモデルは、もともと写真や動画などピクセルという連続したデータを扱うために作られました。

しかし、コードや文章は、一語一語がはっきり区切られた「離散データ」です。この違いから、連続的なデータ用に考えた方法をそのまま使うと、細かい部分や精度が低くなることがあります。

将来の展望

Inception Labsは、Mercuryシリーズの拡張として、チャットアプリ向けのAIモデルをクローズドベータで開発中です。

今後は、

- マルチモーダル機能(テキスト+画像生成)の追加

- 「Chain-of-Thought」による論理的推論の強化

- エッジデバイス(スマートフォンやIoTデバイス)向けの軽量化

を進め、場所を問わず高速なAI生成を可能にする計画。

元OpenAIのAndrej Karpathy氏は、拡散モデル採用のLLMが実用化されることで、新たな長所と短所が見えてくると指摘しています。

まとめ

Mercury Coderは、爆速でコードが書けるAIを活用したコーディング支援ツールとして注目されています。

たった数秒でマインスイーパーやテトリスなどのゲームを作成してくれるので簡単なコーディングの依頼には最適なツールと言えます。

コードの正確性やセキュリティ面での課題がありますが、もしClaude 3.7 Sonnetのような最新AIがこのレベルのスピードを持ったらと考えると、開発が一気に加速しそうでワクワクしますよね!

皆さんもMercury Coderを試して、アプリが瞬時に完成する衝撃的な体験を味わってみてください!

AI-Bridge Labについて

AI-Bridge Labでは、今後も生成AIの活用事例について、継続的に情報を発信していきます。

最新のAI技術とその活用方法について、ぜひ一緒に学んでいきましょう!

最後まで読んでいただき、ありがとうございました。 気に入って頂けましたら「スキ」や「フォロー」「コメント」をしていただけると幸いです😄

コメント